Données obsolètes, doublons, erreurs, … Tous ces facteurs nuisent à l’automatisation des processus avant même leur déclenchement.

Dans cet article, nous sensibilisons sur l’impact de la qualité des données dans toute stratégie d’automatisation, et comment la garantir.

Qu’est-ce qu’on entend par qualité des données ?

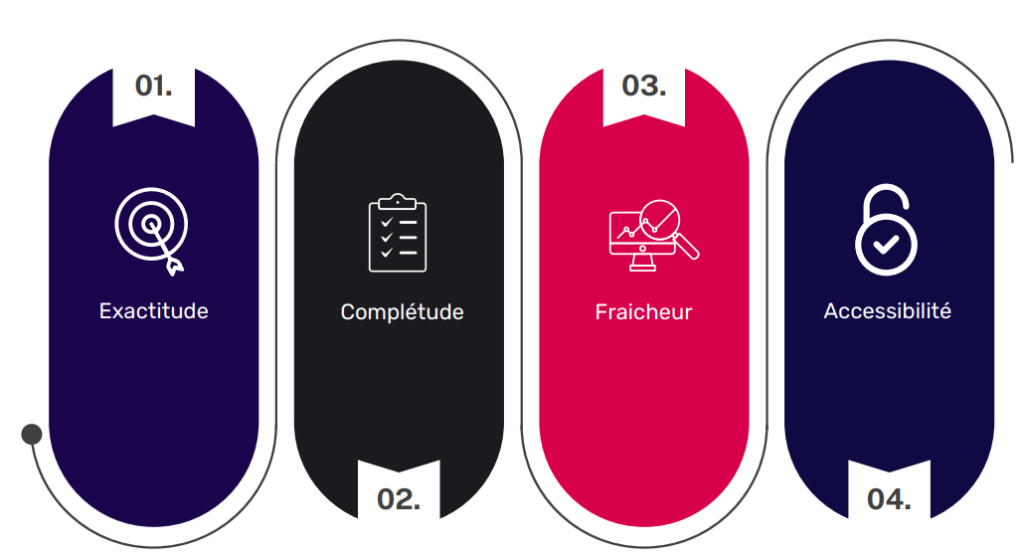

La qualité des données va au-delà d’absence d’erreurs. Une donnée utile et exploitable doit répondre aux quelques critères fondamentaux. Ces critères garantissent la fiabilité et la pertinence. Voici les 4 critères fondamentaux d’une donnée de qualité :

4 piliers de la qualité des données

1. Exactitude

Une donnée exacte reflète la réalité. Elle doit éviter les erreurs de saisie, les fautes de frappe. Il faudrait aussi bien décrire l’information qu’elle représente. Par exemple, une mauvaise adresse postale peut fausser un processus logistique. Dans un processus automatisé, elle peut être à l’origine d’une succession d’envois de courriers et de colis au mauvais endroit.

2. Complétude

Une donnée complète sous-entend que toutes les informations requises y sont. Une commande sans date de livraison compromet le bon fonctionnement des outils qui en dépendent. Les données incomplètes peuvent engendrer des retards, bloquer des traitements, etc.

3. Fraicheur

On appelle donnée fraiche, une donnée à jour. L’information doit refléter l’état le plus récent de la réalité. Un stock de produits non actualisés peut causer le dysfonctionnement des outils de gestion ou d’analyse.

4. Accessibilité

Enfin, les utilisateurs adéquats doivent avoir accès aux données au bon moment et dans le bon format. Une information perd toute sa valeur si elle est bloquée dans un silo ou est illisible pour les utilisateurs finaux. L’accessibilité c’est aussi la facilité d’exploitation.

Téléchargez le livre blanc sur la data governance & automatisation

Dans un processus d’automatisation, chaque détail compte. Le moindre défaut sur un critère peut modifier tout le processus et déclencher une réaction en chaine. C’est la raison pour laquelle la qualité des données doit être considérée comme un enjeu stratégique, pas qu’un souci technique.

Quels sont les risques d’une automatisation sur des données non fiabilisées ?

L’automatisation et l’IA font gagner en efficacité. Par contre, ses avantages repose sur un élément clé : les données fiables. Voyons les différents risques liés à l’automatisation sur des données non fiabilisées :

- Amplification des erreurs : l’automatisation traite des données à grande échelle. L’entrée des données incorrectes propagent rapidement et massivement les erreurs et rend leur correction plus complexe et couteuse.

- Décisions erronées : Les recommandations des systèmes d’automatisation sont fondées sur les données disponibles. Les données inexactes conduisent à des analyses faussées, des choix stratégiques risqués.

- Création de silos et fragmentation de l’information : l’automatisation peut renforcer les silos des données et rendre difficile la consolidation et l’exploitation cohérente de l’information à l’échelle de l’organisation

- Vulnérabilité en cybersécurité : les données mal maitrisées peuvent détourner les processus automatisés. Elles ouvrent la porte à des attaques ou diffusion rapide de codes malveillants.

Cas concret sur l’impact de la mauvaise qualité des données (healthcare)

1. Contexte

Illustrons les conséquences d’une mauvaise qualité des données par Healthcare.gov. Le portail américain d’inscription aux assurances santé a connu un lancement catastrophique en 2013.

Les problèmes clés identifiés étaient : l’intégration déficiente des données et une gouvernance désorganisée.

2. Conséquences immédiates de la mauvaise data quality ?

- Moins de 1% des utilisateurs réussissaient à finaliser leur inscription à cause de données mal intégrées et d’un manque de gouvernance des données.

- 20 millions d’utilisateurs bloqués

Pourquoi la gouvernance des données change la donne ?

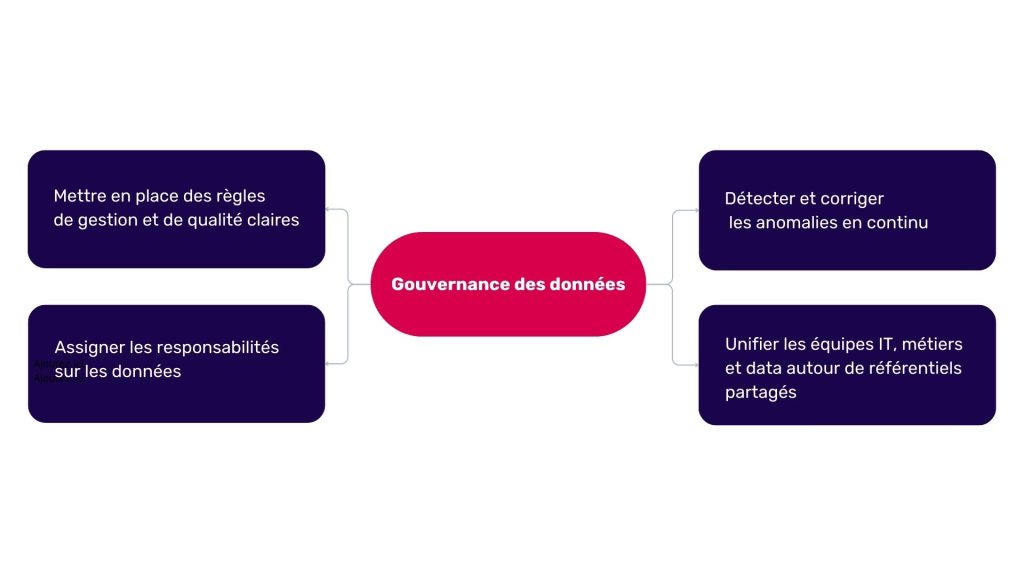

L’exigence d’une automatisation réussie est simple : avoir de données de confiance. C’est la base d’une gouvernance bien pensée.

La gouvernance des données est aussi une discipline structurante qui permet d’industrialiser la donnée comme un actif stratégique.

Voici comment elle transforme votre capacité à automatiser efficacement :

1. Mettre en place des règles de gestion et de qualité claires

Des politiques de data quality formalisées (format, fréquence, seuil d’alerte…), permettent de prévenir les erreurs à la source. Elles ont pour résultats : des pipelines automatisées plus fluides, sans besoin constant de reprises manuelles.

2. Assigner les responsabilités sur les données

La data governance permet de déterminer les rôles des data owners pour chaque domaine métier et des data stewards garants de la qualité au quotidien. Elle élimine les zones d’ombre et facilite l’escalade en cas de problème.

3. Détecter et corriger les anomalies continuellement

Les bons outils (Data Quality Monitoring, MDM, Data Lineage…) permettent une surveillance proactive des données : détection d’incohérences, alertes, correction automatisée ou manuelle. Cela renforce la résilience des automatisations, qui ne s’interrompent plus pour des écarts de qualité.

4. Aligner les équipes IT, métiers et data sur des référentiels communs

Avec un glossaire métier partagé, un data catalog, et des règles de gestion unifiées, tous les acteurs parlent le même langage. Cet alignement réduit les frictions, accélère les cycles projet et permet d’automatiser avec cohérence, quel que soit le service concerné.